France

Euthanasie pour les pauvres, transhumanisme pour les riches !

En Suisse, l’euthanasie est légale, mais il faut un passeport pour l’autre monde. Tout doit être fait dans les règles. Pas de passeport ? Pas d’euthanasie !

Article consultable sur https://politiquemagazine.fr

L’IA nous promet des résultats pertinents à proportion qu’ils sont statistiquement récurrents. Autrement dit, l’IA n’est qu’un collecteur d’opinions déjà formées qui, par principe, rejette ce qui n’est pas majoritairement validé par le consensus. Ce qui est consensuel est donc menacé par ces outils, plus rapides et plus fiables. Mais le consensus a-t-il jamais produit l’intelligence ?

Ce qu’on appelle Intelligence artificielle ou IA est un ensemble varié de techniques informatiques effectuant des opérations complexes d’analyse et de traitement de données, présentées un peu vite comme analogues à l’intelligence humaine ou capables de la simuler. C’est donc une formidable machine de traitement de données, renforcée par une capacité d’apprentissage automatique et donc d’auto-perfectionnement. Et le progrès technique va multiplier ces possibilités, notamment avec les ordinateurs quantiques lorsqu’ils seront pleinement fiables.

Certains des résultats de l’IA sont particulièrement visibles et spectaculaires. Ainsi le fait de pouvoir battre les plus grands champions aux échecs puis au go ou même au poker. Ou plus récemment la capacité de ChatGPT à produire des textes en langage courant en réponse à une question quelconque, et d’engager un dialogue que rien ne distingue en apparence de la réponse d’une personne : des élèves ont pu ainsi faire rédiger leur devoir par le système, de façon superficiellement méconnaissable (sauf l’absence de fautes d’orthographe…). Parallèlement l’IA est utilisée massivement dans de multiples applications plus spécialisées très efficaces, dont on se sert tous les jours : moteurs de recherche, itinéraire, traduction, reconnaissance faciale, pilotage automatique, diagnostic médical, etc.

En sens inverse, les interrogations pratiquées ici ou là de ce même ChatGPT en ont montré les limites : des erreurs matérielles – quand il ne sait pas bien, il extrapole allégrement et invente – et des incohérences logiques : le système ne raisonne pas, mais combine des données de façon probabiliste ; bien sûr, ces données et ces combinaisons elles-mêmes contiennent des raisonnements, mais ChatGPT ne fait que les regrouper. Personnellement je l’ai interrogé sur mon propre cas, et j’ai été stupéfait de voir le système me donner avec un total aplomb et de façon répétée des informations factuelles parfaitement fausses, et ne ressemblant que de loin à la réalité (date de naissance, profil de carrière, appartenance à des organisations, etc.). On nous promet moins d’erreurs avec GPT-4 (nouvelle version juste sortie) ; mais il reste qu’on ne peut confondre un outil probabiliste avec une recherche directe de faits.

En résumé, l’IA constitue un ensemble d’outils très puissants dans des domaines spécialisés, où la probabilité de pertinence des résultats obtenus peut être très forte, même si ces outils ont besoin de surveillance humaine compte tenu des ratés, et beaucoup moins convaincante lorsque le champ s’élargit au-delà de ses zones de validité.

Mais les zones de succès sont suffisamment larges pour qu’on puisse prévoir que le développement de son rôle à l’avenir sera massif. Si vous tapez Intelligence artificielle sur Google vous tombez en majorité sur des publicités de services expliquant aux entreprises comment s’assurer de ses bienfaits. Ce qui pose d’ailleurs pour ces utilisateurs de nombreuses et importantes interrogations : d’ordre technique, car ces bases de données sont coûteuses et très sensibles aux perturbations (y compris malveillantes) et que la démarche IA n’a de sens que sur une échelle et dans des conditions suffisantes ; et d’ordre éthique, notamment sur la qualité des données utilisées et sur celle des algorithmes. Mais plus largement, l’IA suscite deux séries de questions : impacts sur la société, et questions philosophiques.

Impact sur l’emploi d’abord, et notamment par disparition d’emplois jusqu’ici valorisants : juristes, comptables, soignants, gestionnaires de tout type, contrôleurs, enseignants, programmateurs, etc., voient et surtout verront une partie appréciable de leur travail effectué plus rapidement et pour un coût moindre par des machines. Si d’un côté cela permettra un enrichissement des tâches de certains, et permettra de nouveaux services, d’un autre côté cela menacera directement de nombreux emplois, l’effet final algébrique étant inconnu. D’ailleurs Internet a créé plus d’emplois de livreurs que d’informaticiens, et détruit bien des emplois de libraires et autres commerçants. Au minimum, en tout cas, ce devrait être un facteur de bouleversement appréciable. Un risque étant notamment une division toujours croissante entre des tâches encore plus nobles mais peu nombreuses, et des emplois plus banalisés, là où la machine ne peut pas aller (travail physique), ou à son service (ainsi pour la collecte de données, dans ce qu’on appelle le micro-travail).

Impact en termes de responsabilité : la relative autonomie des machines, dont les processus peuvent être opaques même à leurs auteurs, la facilité d’utilisation, et l’autorité de ces outils puissants et supposés neutres, peuvent entraîner une formidable déresponsabilisation. Or jusqu’à plus ample informé, seul l’homme est capable de responsabilité morale, et donc la véritable décision devrait idéalement rester humaine, tant au niveau du concepteur que de l’utilisateur qui décide, ou pas, de s’en remettre à la machine. Mais la facilité ira en sens inverse…

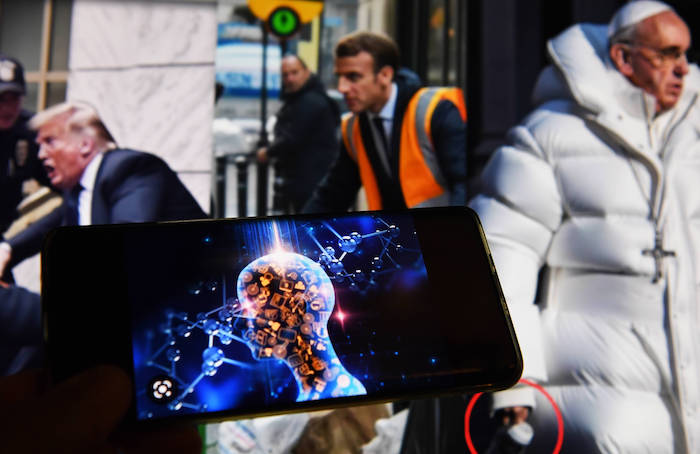

Impact sur la question de l’information sociale et du débat public. Le pape François avait alerté sur l’utilisation de l’IA pour « faire circuler des opinions tendancieuses et de fausses données, empoisonner les débats publics et même manipuler les opinions de millions de personnes…, au point de mettre en danger les institutions à même de garantir une coexistence civile pacifique ». De fait, ChatGPT, par exemple, outre sa propension à inventer là où il n’a pas de réponse, et l’absence complète d’indication de ses sources, est manifestement programmé pour être politiquement correct. Et on peut encore raffiner. La recherche de fiabilité peut même, par un paradoxe apparent, renforcer cette tendance.

Impact sur le contrôle social, comme nous le rappelle l’exemple chinois (crédit social, contrôle généralisé, etc.). En l’état, il peut apparaître répulsif, mais on peut trouver des manières de justifier de telles pratiques qui soient plus cohérentes avec les préoccupations de nos sociétés, notamment en termes de sécurité. Ou de politiquement correct…

Impact enfin sur la compétition économique entre pays. Une avance marquée en termes d’IA donnera au pays concerné un avantage considérable sur ses concurrents, et cela dans bien des domaines (économique, militaire, médical, etc.). Or cela repose à la fois sur la qualité des algorithmes et sur la taille et la qualité des bases de données sur lesquelles sont entraînés les algorithmes et dans lesquelles ils puisent. De ce point de vue, un grand pays, surtout sans inhibition sur la collecte de données, peut avoir un avantage considérable. De même pour ceux capables de développer sur large échelle la recherche algorithmique. Plus généralement, il apparaît que l’IA donne une prime à la taille et à la puissance. Au stade actuel, les États-Unis d’abord, la Chine ensuite, ont une nette avance, qu’ils ont des chances de garder, et ils ne sont suivis que d’assez loin par l’Europe et le Japon. Un sérieux effort serait ici indispensable dans nos pays.

Dans quelle mesure cette recherche, censément d’une forme d’intelligence, peut-elle déboucher sur l’acquisition d’attributs actuellement vus comme le propre de la personne humaine ? La puissance de calcul est une chose, la rationalité, l’imagination, la recherche du sens, la responsabilité, la capacité de relation avec d’autres personnes et plus largement la conscience et la liberté, en sont d’autres, jugés caractéristiques de la personne humaine. Rien ne dit à ce stade que la machine puisse en être dotée un jour : plus que penser, elle fonctionne, déroulant ses algorithmes programmés, qui, même s’ils ne sont plus toujours analysables du dehors, restent strictement déterministes. Relier statistiquement des concepts est tout autre chose que réfléchir dessus.

Mais les tenants de la technologie conquérante pensent que ce stade sera dépassé, et qu’au bout du processus émergera une véritable conscience avec tous ses attributs, en tout cas largement équivalents à ceux de la personne humaine, et bien plus performants. Nous ne connaissons pas l’avenir. Mais en fin de compte, la question est fondamentalement philosophique, et recouvre l’opposition entre matérialistes et non-matérialistes.

Si vous considérez que la pensée et la conscience ne sont que le résultat de processus matériels, vous devez conclure qu’il y a toutes chances qu’un processus puisse les dupliquer un jour, et l’IA est alors un candidat prometteur.

Dans le cas contraire, le fait que l’IA puisse être à même de battre dans de très nombreux domaines ce qu’on attribuait à l’intelligence humaine ne change pas la différence de nature entre celle-ci et une supposée intelligence artificielle qui ne fait que la mimer mais ne comporte pas de pensée, encore moins consciente. Cela ressemble aux réflexions sur le transhumanisme, avec son rêve d’une immortalité obtenue en transposant sur une machine le logiciel qu’est supposé être l’esprit d’une personne : ici aussi, l’enjeu de l’innovation technologique porte sur une question philosophique majeure.

Cela dit, il ne sera sans doute pas aisé de distinguer entre un système très perfectionné et dressé pour mimer un comportement humain et un véritable être humain. En d’autres termes, le test de Turing (la possibilité de distinguer un ordinateur et une personne par les réponses qu’ils donnent) pourrait ne pas fournir de réponse. Comment savoir en effet s’il y a conscience, ou simple simulation de conscience ? En termes pratiques, il sera probablement difficile dans quelques années de distinguer le comportement de notre cher Emmanuel Macron, pour prendre un exemple qui s’y prête, d’un bon programme d’IA. Si en revanche vous croyez en la réalité de l’esprit, et plus encore en Dieu, l’IA ne devrait pas trop vous inquiéter, en tout cas sur rien de fondamental.

En définitive, à côté du renforcement des inégalités, au sein des sociétés et entre États, mais aussi d’une offre enrichie de services, la conséquence la plus claire de l’IA sera sans doute une accentuation du brouillage des repères qui caractérise nos sociétés pour la grande majorité des gens. Soit dans leurs valeurs fondamentales, toute forme de religion ayant disparu de leur vie. Soit plus concrètement dans leur travail, leur autonomie, leur capacité critique face à l’information ou au contrôle, etc., ne leur laissant dans le pire des cas que la dissidence intérieure ou la jacquerie anarchique. Sauf à utiliser astucieusement les limites du système… Mais on s’éloignera plus encore de l’utopie démocratique.